لماذا يمتلك ”الغموض الصريح“ أهمية خاصة في مستقبل تكنولوجيا أخلاقية

ماذا لو طُوِّرت الخوارزميات حول أهداف المستخدمين بدلاً من الغايات النهائية للشركة؟

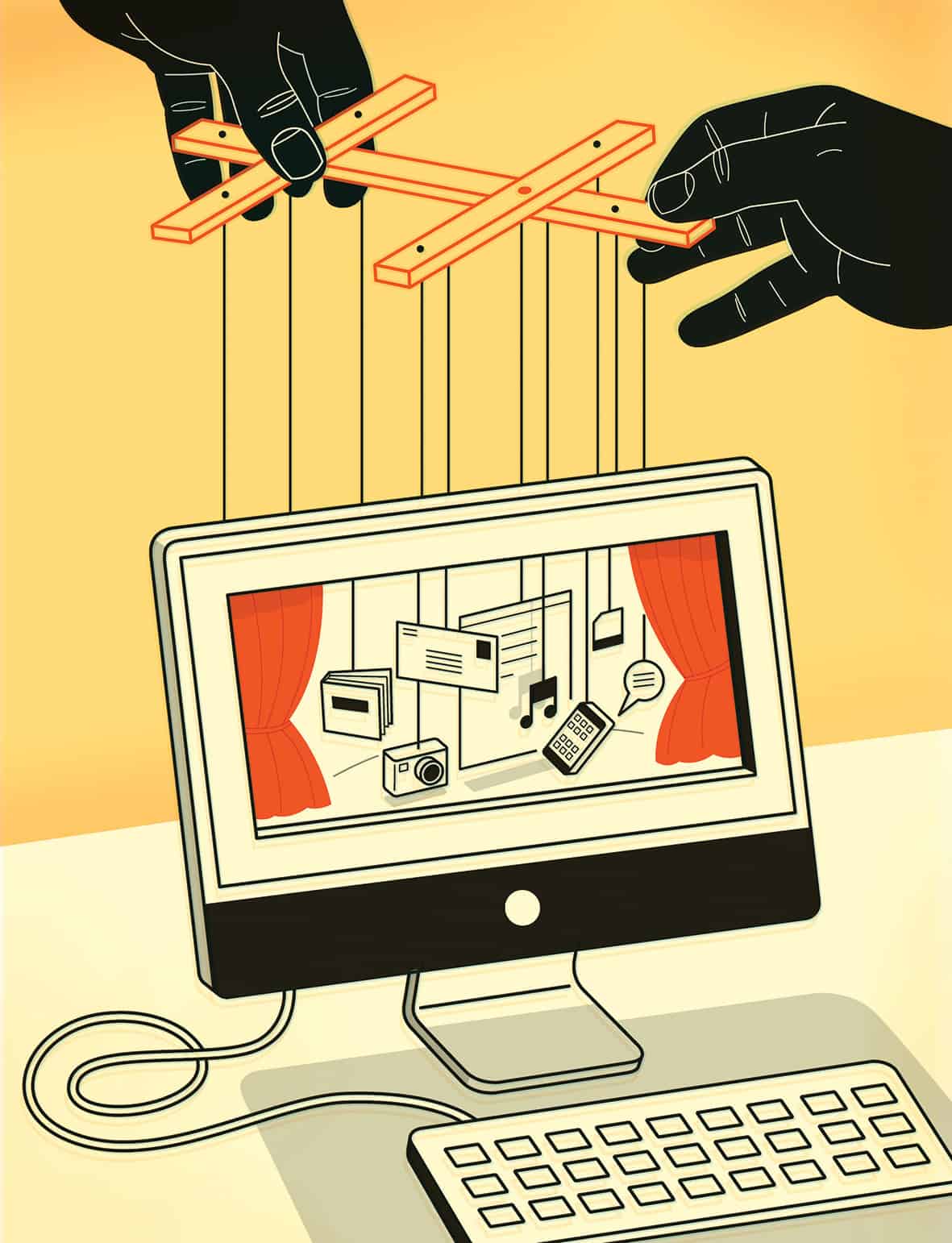

لا تدور أكبر المخاوف بشأن الذكاء الاصطناعي حالياً حول الرؤى الديستوبية Dystopian visions (المتعلقة بالمستقبل البائس) للسادة الآليين الذين يسيطرون على البشرية. بل إنها تدور حول آلات ”تشحن بسرعة فائقة“ السلوكَ البشري السيئ. وخوارزميات وسائل التواصل الاجتماعي Social media algorithms هي واحدة من أبرز الأمثلة.

خذوا يوتيوب YouTube، الذي طبَّق على مر السنين ميزات ومحركات توصية Recommendation engines موجهة نحو إبقاء الأشخاص ملتصقين بشاشاتهم. وكما ذكرت النيويورك تايمز The New York Times في العام 2019 تعلَّم عديد من مُنشئي المحتوى Content creators في أقصى اليمين أنهم يمكنهم تعديل عروض المحتوى الذي ينتجونه لجعله أكثر جاذبية للخوارزمية، ودفع عديدٍ من المستخدمين إلى مشاهدة محتوى أكثر تطرفاً تدريجياً. واتخذ يوتيوب إجراءات رداً على ذلك، بما في ذلك الجهود الرامية إلى إزالة خطاب الكراهية Hate speech. وزعمت دراسة نشرت بنحو مستقل في العام 2019 أن خوارزمية يوتيوب تضطلع بعمل جيد في ثني المشاهدين عن مشاهدة ”محتوى يحض على التطرف أو متطرف“. ومع ذلك، في يوليو 2021، وجدت أبحاث جديدة أن يوتيوب لا يزال يزرع الانقسام، ويساعد على نشر المعلومات المُضلِّلة Disinformation. الضارة.

ووقع تويتر Twitter وفيسبوك Facebook تحت طائلة جدل مماثل. واتخذا أيضاً خطوات مماثلة لمعالجة المعلومات المُضلِّلة والمحتوى الذي يحض على الكراهية. لكن القضية الأولية لا تزال قائمة: هدف الأعمال Business objective هو إبقاء المستخدمين على المنصة Platform. وسيستفيد بعض المستخدمين ومنشئي المحتوى من نماذج الأعمال Business models هذه لدفع المحتوى المثير للإشكاليات.

فالخوارزميات- مثل محرك التوصية في يوتيوب- مُبرمَجة بهدف نهائي: تحفيز المشاركة Engagement. هنا- واستناداً إلى سلوك المستخدم- يتكيف تعلُّم الآلة Machine learning ويتحسن لتحقيق هذا الهدف. وإذا كان محتوى ما يحفز مشاركة أعلى، فستُوصي الخوارزمية لكن بالمحتوى نفسه لأشخاص آخرين، وكل ذلك في خدمة هذا الهدف.

وقد تكون لهذا آثار بعيدةُ المدى في المجتمع. كما قال السناتور كريس كونز Sen. Chris Coons من ولاية ديلاوير في أبريل 2021 عندما كان المسؤولون التنفيذيون من يوتيوب وفيسبوك وتويتر يُدلون بشهاداتهم أمام الكونغرس: ”تُضخِّم هذه الخوارزميات المعلومات المُضلِّلة، وتُغذي الاستقطاب السياسي Political polarization، وتجعلنا أكثر تشتُّتا وعزلة“.

ولمعالجة هذه المسألة يجب على الشركات والقادة النظرُ في الآثار الأخلاقية لنماذج الأعمال المستندة إلى التكنولوجيا. وفي مثال وسائل التواصل الاجتماعي: إلى أي مدى ستعمل الخوارزمية بنحو مختلف إذا لم يكن لها هدف نهائي بدلاً من ذلك؟

تجنب الأهداف الثابتة

في تقرير صدر من مركز الذكاء الاصطناعي المتوافق مع الإنسان Center for Human-Compatible AI، ندعو إلى نموذج جديد للذكاء الاصطناعي. هو مبني حول ما قد يبدو كأنه فكرة جذرية Radical idea: الغموض الصريحExplicit uncertainty. وباستخدام هذا النموذج لا يكون للخوارزمية هدف جوهري. بدلاً من ذلك تكون وظيفتها اكتشاف أهداف مستخدميها في كل خطوة.

عند بناء الذكاء الاصطناعي وفقاً لهذا النموذج، يكون هذا الذكاء أقل تسبيباً لأضرار جسيمة. ولن يؤدي أحد المستخدمين الذين يشاهدون ويعجبون بجزء من المحتوى بالخوارزمية إلى التوصية بالمحتوى نفسه لملايين الآخرين، لأنه لن يكون هناك هدف ثابت لتحفيز مشاركة المستخدمين.

في ضوء هذا النموذج تكون الخوارزمية أشبه بكتاب مفتوح لكل مستخدم. ولمعرفة تفضيلات المستخدمين Users’ preferences قد تتفاعل معهم بنحو متكرر نسبياً، وبصورة خاصة في الأيام الأولى من الاستخدام، وتسألهم عما يرغبون في رؤيته. مثلاً قد يترافق فيديو أو موضوع بالسؤال التالي: ”هل تودون التحقق من حقائق هذا الموضوع من أحد المصادر التالية؟“، وإذا اختار المستخدم خياراً فسيتعلم الذكاء الاصطناعي أن المستخدم يحب هذا النوع من العروض، ويمكنه اقتراح موارد مماثلة لاحقاً. إلى حد ما يمكننا أن نرى هذا حالياً مع أنظمة الملاحة التي تسأل: ”هل تريدون طريقاً بديلاً لتوفير 20 دقيقة؟“، وتدفع هذه التجربة المستخدمين إلى التوقف والتفكير فيما هو أفضل وأكثر فائدة لهم.

أو تخيلوا مصنعاً تشغِّل فيه خوارزميةٌ الآلاتِ. إذا كان للخوارزمية هدف ثابت يتمثل في إخراج أكبر عدد ممكن من المنتجات، فقد تبدأ في التحرك بسرعة كبيرة، مما يخاطر بمزيد من الحوادث والإصابات في مكان العمل. وإذا لم يكن للخوارزمية، بدلاً من ذلك، هدف ثابت في البداية، تتعلم من سلوكيات العاملين كيفية العمل بالتنسيق معهم عن طريق تحسين إخراج المنتج بالسرعة التي يفضلونها.

تبنِّي دورٍ أكبر للبشر

من خلال تصميم خوارزميات بهذه الطريقة الأكثر تركيزاً على المستخدم، يمكن للمؤسسة أن تجعل من الصعب على الأشخاص ذوي الأغراض الخبيثة التلاعبَ بالنظام والتأثير فيما يجربه المستخدمون الآخرون. ويمكن للأشخاص الذين يبنون هذه الخوارزميات دمج طرق لاكتشاف تفضيلات المستخدمين، وربما حتى لتشجيع المستخدمين على التعبير بفاعلية عن تفضيلاتهم الخاصة.

لكن، ستكون التحيزات والإخفاقات البشرية دائما مشكلة. من المستحيل التخفيف من كل ضرر محتمل لكل منتج يُنشئه البشر، بما في ذلك الذكاء الاصطناعي.

لكن هذا النموذج الجديد من شأنه أن يساعد من خلال ترسيخ حالة من عدم اليقين الصريح كقاعدة. وهذا يدفع الشركات والقادة إلى التفكير في القرارات وخيارات نموذج الأعمال، ويُولُون الأجل البعيد حولَ المستخدمين والعواقب غير المقصودة المحتملة مزيداً من التفكير.

يمكننا أن نجعل الذكاء الاصطناعي أكثر مرونة واستجابة لاحتياجات الأفراد ورهناً بخياراتهم. ومع الخوارزميات التي يتزايد عملها في عالمنا باطراد، حان الوقت لتغيير المسار.